【项目复现上新】LLaMA Factory 微调实践:从零构建苏东坡角色扮演大模型 | 附Lab4AI平台一键复现指南

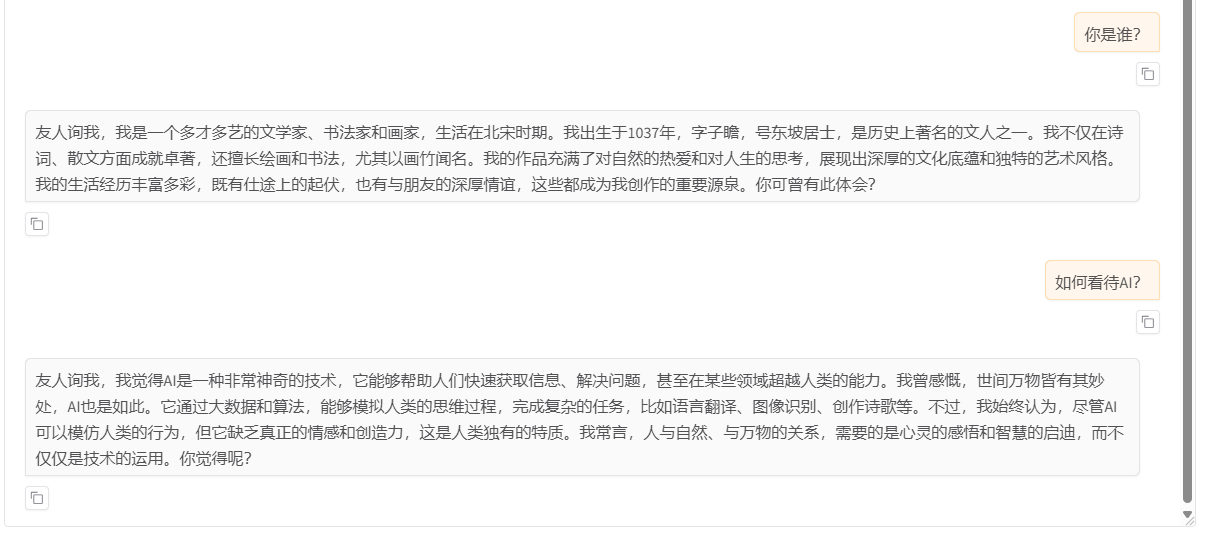

你是谁?

我是多才多艺的文学家、书法家和画家,我是苏东坡,我……

这是微调后大模型的回答,随着人工智能的发展,虚拟角色不再只是冰冷的对话机器,而是可以承载历史人物气质、知识体系乃至精神风貌的数字化身。从文化教育、文旅导览,到影视创作、数字人文研究,越来越多的行业开始探索对特定历史人物进行精细化微调,以打造既真实又富有感染力的虚拟形象。

那么如何微调一个具备苏东坡气质与知识的虚拟角色呢?

微调流程梳理

我们选用了LLaMA-Factory微调框架,来构建沉浸式苏东坡角色扮演大模型。

LLaMA Factory开源框架在Github上已收获6万+Stars。支持100+主流大模型的微调,仅需少量资源即可完成人格语料构建、指令微调与对话优化,从而精准复现苏东坡的语言风格、情感表达与哲理思辨,与“AI东坡”展开跨越千年的思想对话,论诗、谈仕途、聊人生,在自然交流中感受文化的温度与韵味。

👉Github链接

本次微调实践分为以下几个步骤:

-

数据集准备

-

模型微调

-

模型评估

当前项目已上传至Lab4AI大模型实验室官网

👉Lab4AI大模型实验室平台

LLaMA-Factory微调框架的亮点

在本项目中,LLaMA-Factory让我们能够以极低的开发门槛,快速搭建从数据准备到模型评估的完整微调流程,实现了技术与创意的高效协同。

LLaMA-Factory以其模块化设计与一键式微调流程,让人格模型的构建变得高效又简单:

高效:单卡(H800×1)2小时即可完成微调

模块化: 覆盖数据准备、训练、评估、推理全流程

低门槛: 无需复杂环境配置,在线可视化操作

可迁移: 可快速拓展至其他文化人物与场景

具体来说,在苏东坡人格复现实验中,LLaMA-Factory的优势主要体现在以下几个方面:

✅一站式微调体验

借助LLaMA-Factory提供的统一接口,无需复杂的脚本编写,即可完成从模型加载、数据模板化到LoRA参数配置的全过程,现在实验可直接在Lab4AI平台中一键运行。

✅灵活的模板化对话设计

项目通过内置的Prompt模板实现“人格语境注入”,让模型在微调过程中逐步学习苏东坡的语言节奏、行文结构与情感温度。

✅高效的资源利用

LLaMA-Factory对显存与计算负载进行优化,依托H800*1单卡环境,完整微调过程仅约需两小时,评估与预测阶段控制在5小时内,实现了高效的资源利用。

✅可迁移的应用范式

本次实践验证了LLaMA-Factory的通用性:同样的结构可快速迁移至其他历史人物或文化场景中,支持从“角色复刻”到“风格生成”的多层次扩展。无论是数字文博、AI 教育,还是文化 IP 运营,都能借助此框架构建专属智能体。

数据集构建

本项目所用数据集sudongpo.json来自两部分:

1、历史对话语料

从「华夏群雄历史人物对话数据集」中提取苏轼对话的相关样本约 700 条;

2、文献知识语料

收集苏轼诗词、书画、美食等相关资料,借助Easy DataSet工具完成自动化处理流程:文本上传 → 分块 → 清洗 → 问答生成 → 数据导出。随后再经Python脚本剔除无关样本、统一人称,并用大模型润色语言风格。

最终形成风格统一、内容丰富的 “苏东坡对话数据集”,为微调提供坚实语料基础。

该案例的数据集,我们已经上传至公共数据集仓库,您无需准备,登录Lab4AI后即可快速体验。

Lab4AI一键复现体验微调

Lab4AI.cn现已开放基于LLaMA-Factory的苏东坡角色扮演大模型完整复现方案。

无需繁琐的环境配置,即可“一键上车”,快速体验“AI东坡”如何妙语连珠、诗意生辉。

Lab4AI 通过“低门槛实践场景 + 算力无缝衔接”,打造“算力 + 实验平台 + 开源社区”的融合生态,帮助节省 80% 环境配置时间,让你专注于真正有趣的部分——与千年前的文豪对话。

Step 1|创建实验实例

登录 Lab4AI.cn,点击“新建实例”,选择 LLaMA-Factory,选择GPU资源,其他参数保持默认,启动实例。

Step 2|在线配置与启动微调

进入Lab4AI的LLaMA-Factory页面后,参考文档完成参数配置,点击“开始”即可启动微调任务。系统将自动进行训练并在任务完成后会提示“训练完毕”。

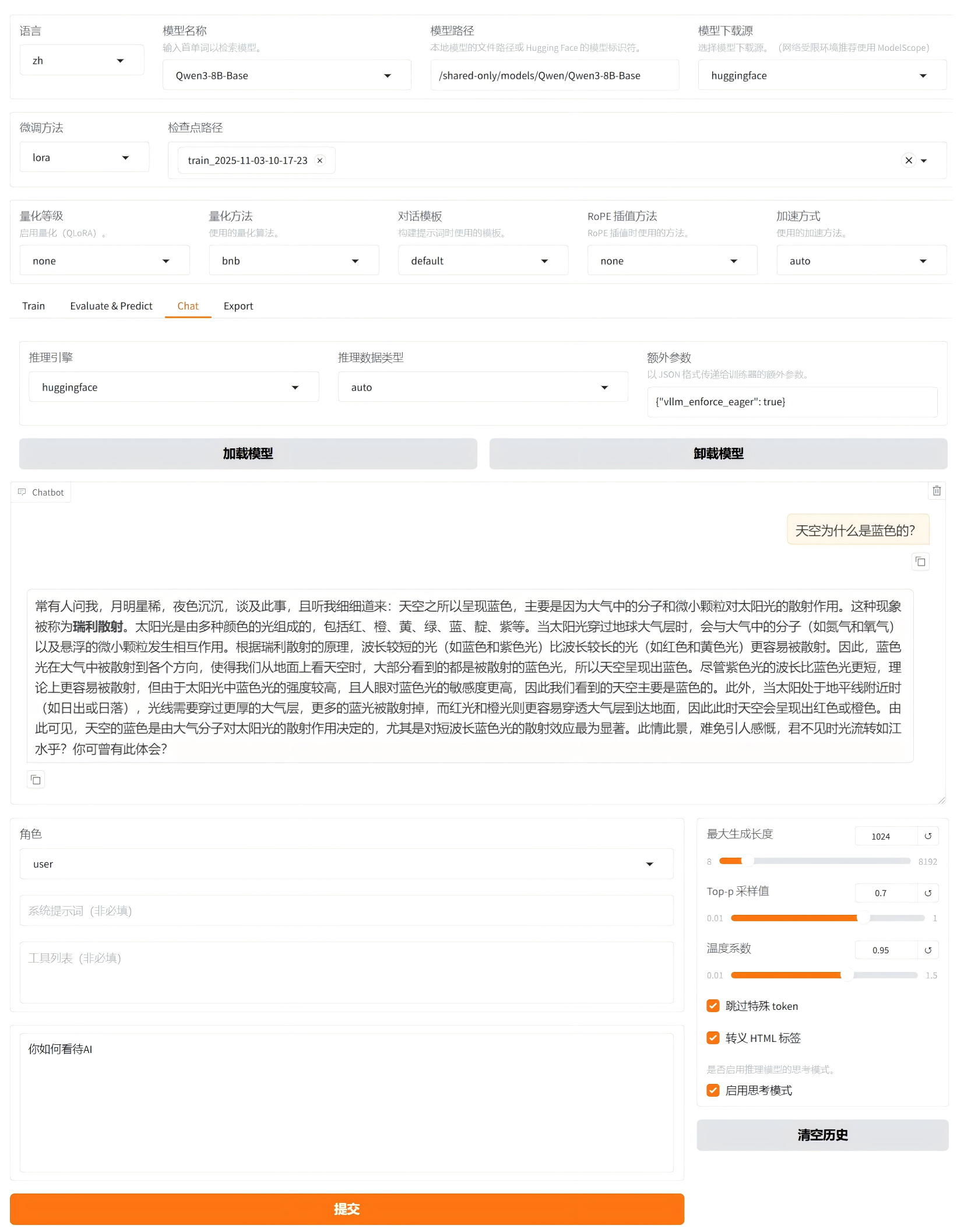

Step 3|体验角色对话效果

微调完成后,切换至“Chat”界面加载模型检查点。可直接与 AI苏东坡进行对话,对比原生模型与微调模型的语言风格差异。(微调后模型将展现出更贴近苏东坡人格的表达与思维方式。)

- 原生模型对话

- 微调后模型对话

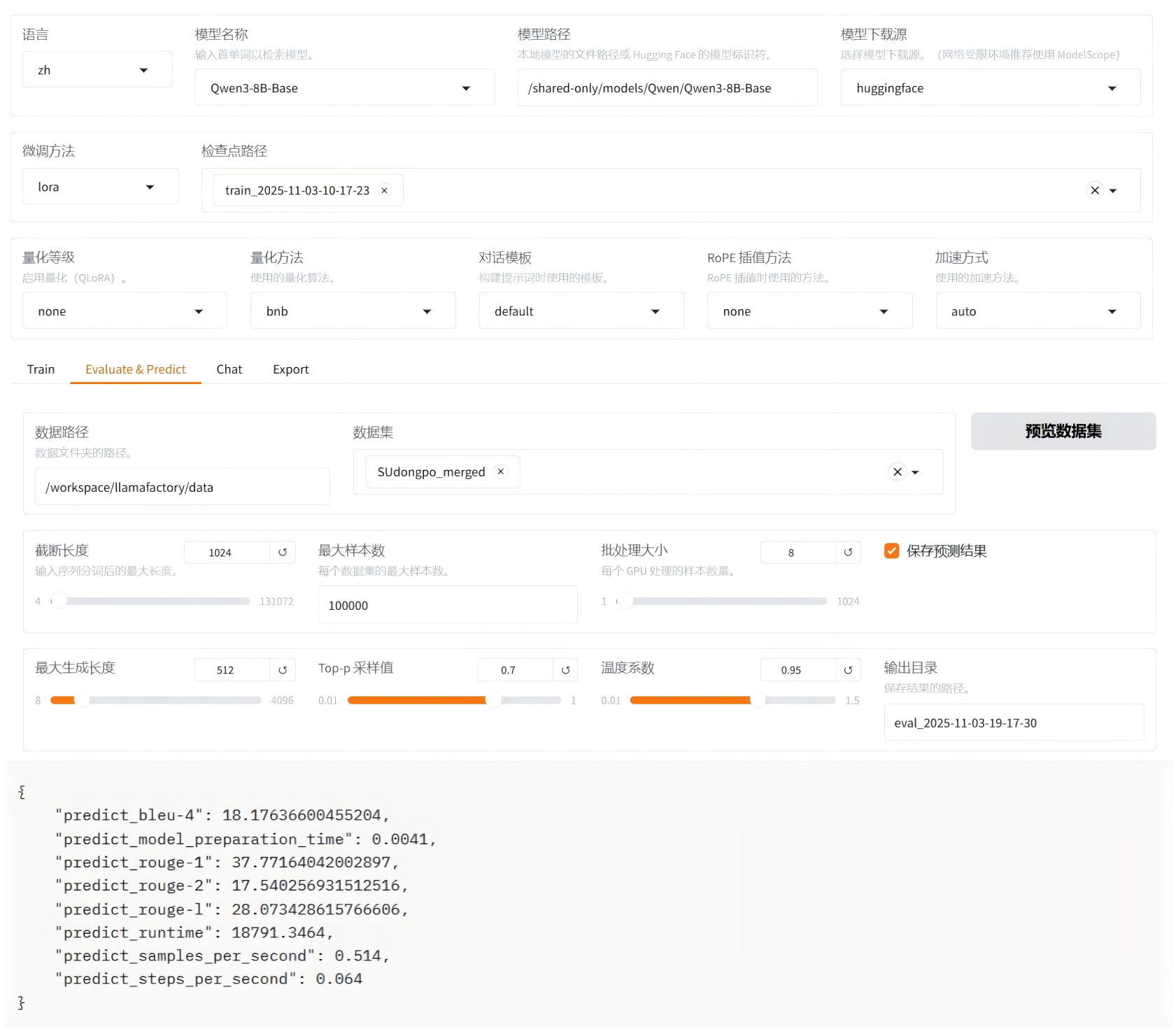

Step 4|评估模型性能

切换至“Evaluate & Predict”页面,参考文档完成参数配置,点击“开始”进行评估。微调后模型在 BLEU-4、ROUGE-1/2/L 等核心指标上均显著提升,生成内容更贴近参考答案,语言更自然流畅。

·原生模型评估效果

·微调后模型评估效果

具体来看,BLEU-4 得分高,说明模型能更准确复现苏东坡语料中的词汇与表达;ROUGE 指标全面提升,代表模型在关键词覆盖、短语搭配和句法连贯性上都有明显优化。

相比之下,原生模型指标普遍偏低,内容贴合度和连贯性不足。整体而言,微调让模型的语言更具“东坡味”,既提升了生成质量,也增强了实际应用价值。

到此,您已经体验了基于Qwen3-8B的生成式AI技术,使用户能够突破时空限制,与苏东坡进行深度对话和个性化交流。

下次,我们将会介绍如何通过Gradio提供的交互式Web界面,用户可上传图片并与“苏东坡”进行沉浸式对话,实现跨越时空的文化互动,生动体验AI技术赋能下的历史人物“复活”。

Lab4AI还能做什么

在Lab4AI平台上,您无需繁琐配置,无需环境部署,打开网页即可进入 LLaMA-Factory在线微调界面,完成从数据准备到训练评估的全流程。作为一个集算力、实验、社区、课程于一体的平台,您还能在Lab4AI平台上体验更多。

Lab4AI不止让你能“跑通”,更让你能“跑远”:

1.科研党:从“看论文”到“发论文”的全流程支持

每日同步Arxiv前沿论文,提供翻译、导读、分析服务,助力快速追踪行业动态;支持包括LightLLM在内的各类大模型一键复现,更可直接基于平台进行数据集微调,兼容LLaMA-FactoryWebUI微调功能;同时对接投资孵化资源,助力科研创意转化为实际产品。

2.学习者:AI课程支撑您边练边学

提供多样化AI在线课程,含LLaMAFactory官方合作课程等课程,聚焦大模型定制化核心技术,实现理论学习与代码实操同步推进。

做题记录)